SD 基础使用教程

1. 硬件要求

- 最低配置

- RTX2060 及同等性能显卡

- 显存 6G,内存 8G

- 硬盘空间 20G

- 推荐配置

- RTX3060Ti 及同等性能显卡

- 显存 8G,内存 16G

- 100-150G 硬盘空间

倘若你对于自己的硬件性能非常自信,那么你可以对照着本篇顶部的参考文档来进行本地部署,当然了,下面的文档也会对你的部署有所帮助,只不过是为了在云服务器上部署而稍微多了几个步骤而已。

🤔我的笔记本可是 RTX4060,是不是比 3060Ti 厉害很多?

笔记本 4060,即 NVIDIA GeForce RTX 4060 Laptap,性能基本相当于台式机 RTX3060,跑应该是能跑的(我没试过),但我仍然建议你在云服务器上部署它,一方面可以获得更好的性能,出图更加舒服,并且 8G 显存 16G 内存的要求对于一般的游戏本来说也是很危险的,稍微一个不小心就会爆显存;一方面部署 SD 涉及到一系列的环境安装,要是出了什么问题重新开一台服务器就好了。

2. 搭建过程

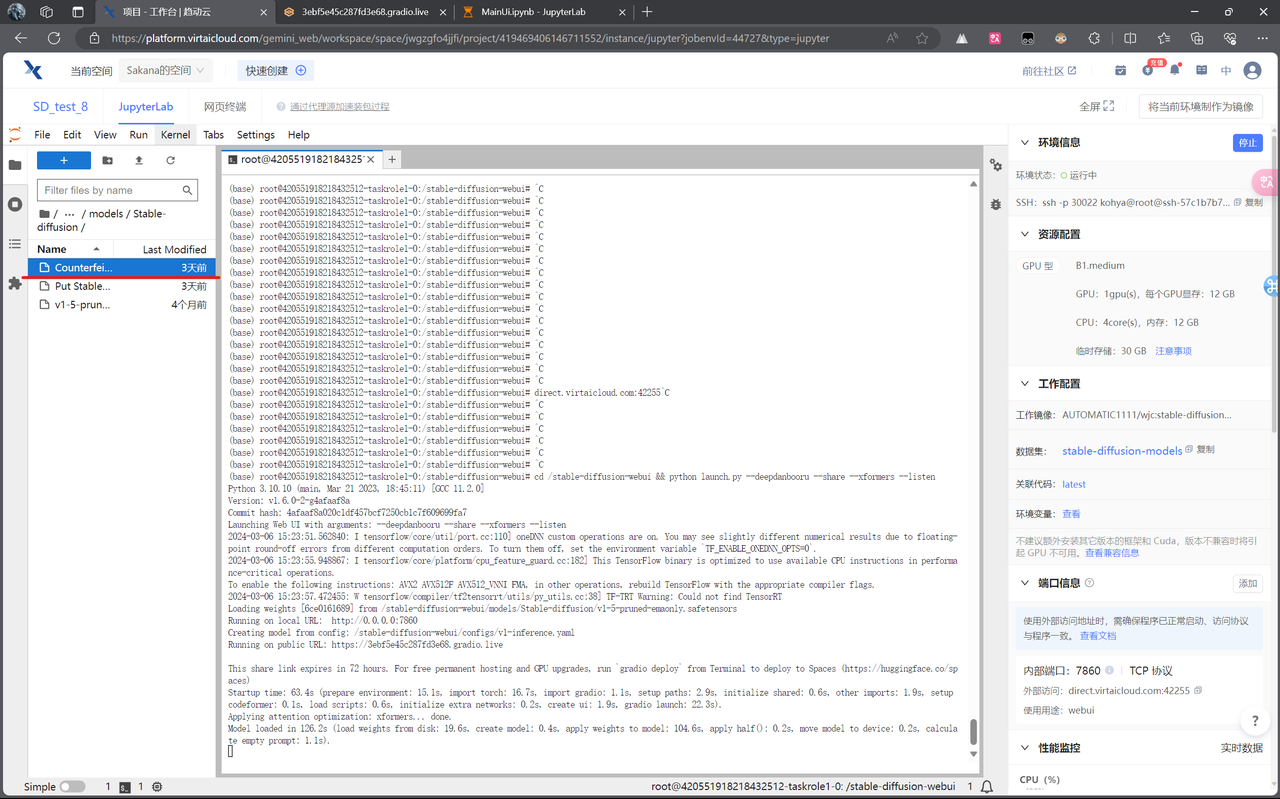

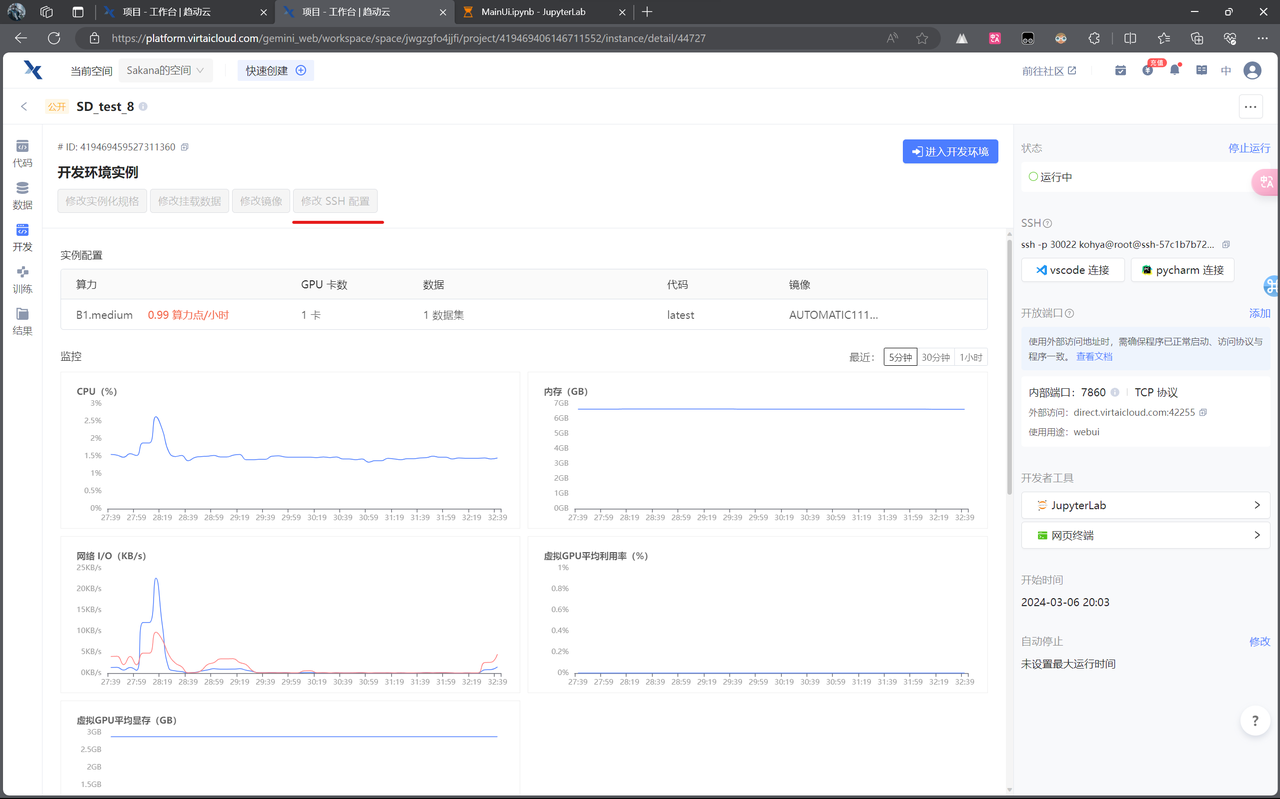

我们的目标是在趋动云上部署我们的 Stable Diffusion WebUI 1.7

修改警告

部署教程已过时,想要进行部署的同学可以使用 AutoDL 进行一键部署,简单方便。

3. 更精准的描述:简单的参数 / 提示词(Prompt)使用手册

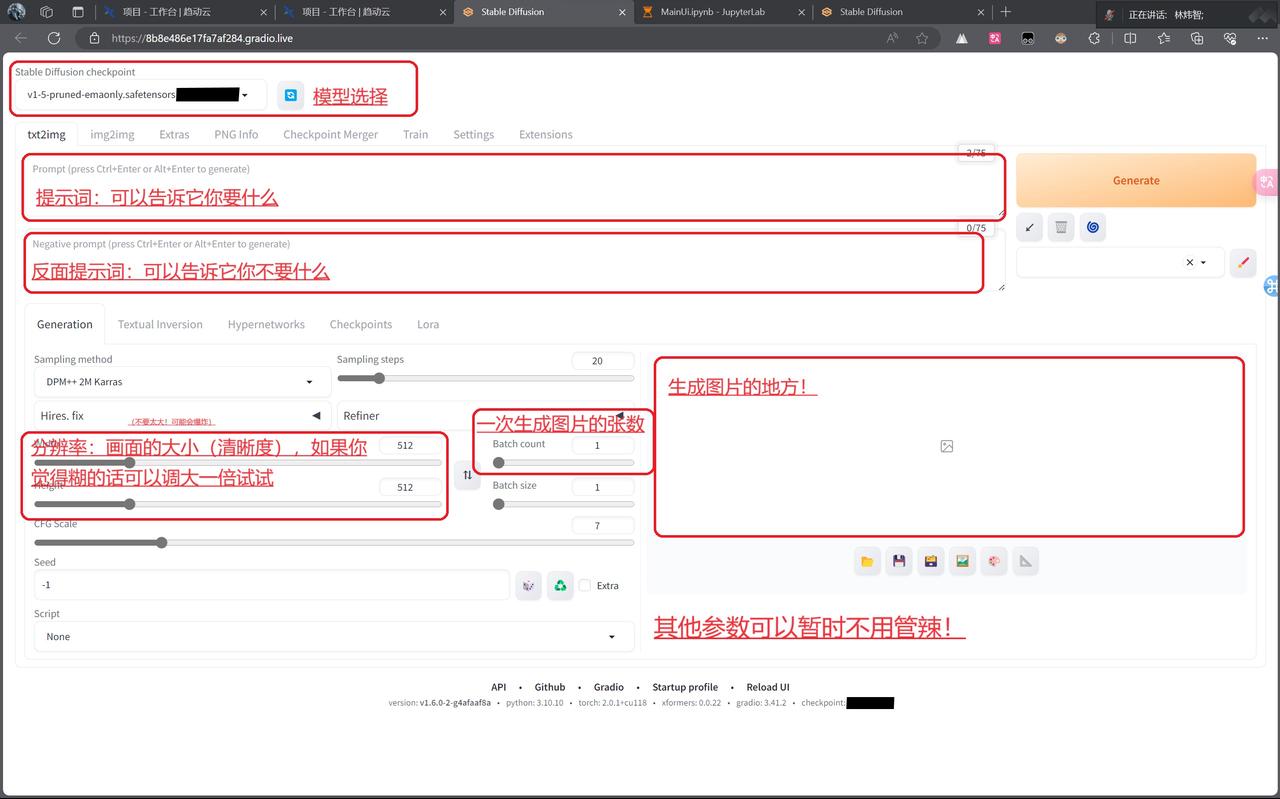

Step1:基本使用

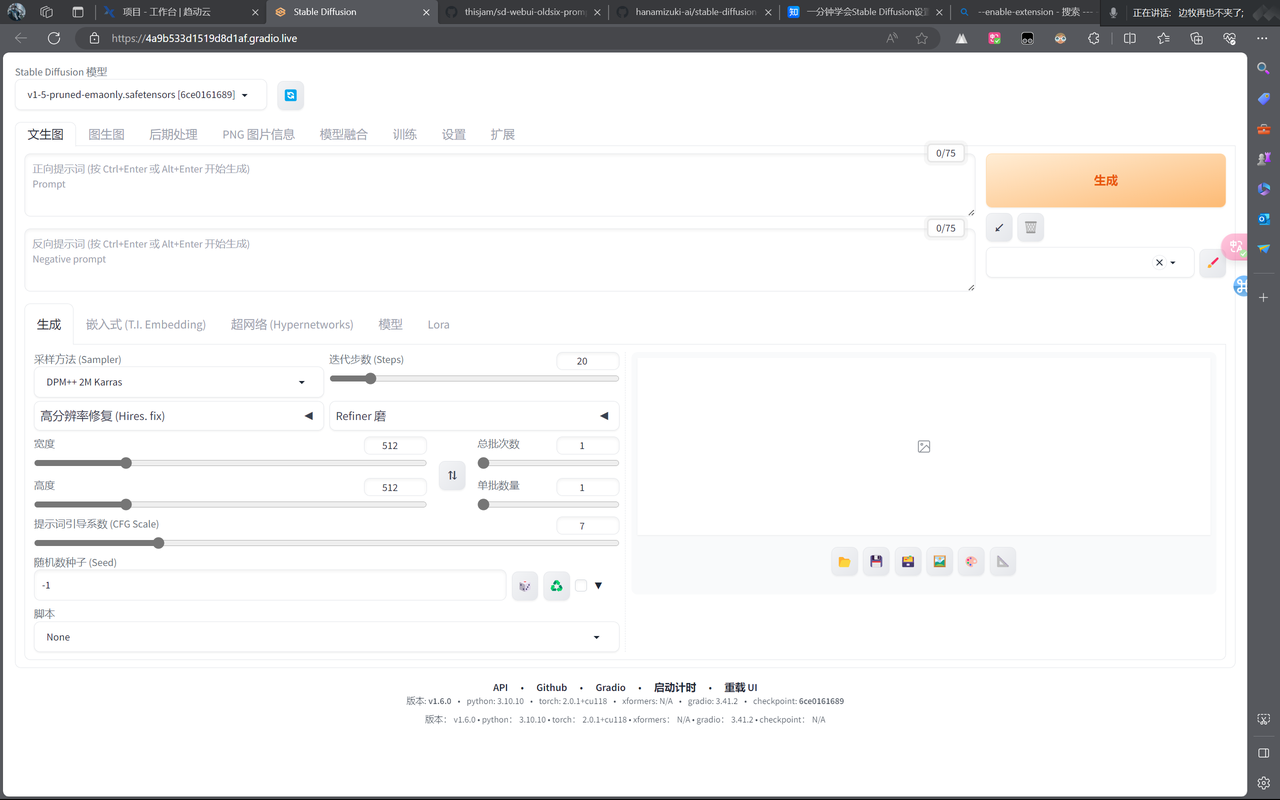

- 让我们先来大致的了解一下 WebUI 的界面

如果你对英文不太熟悉,我强烈建议你先到插件安装学习安装一个中文插件

记住!大模型不认识中文,即便安装了中文插件,提示词的输入也只能使用全英文

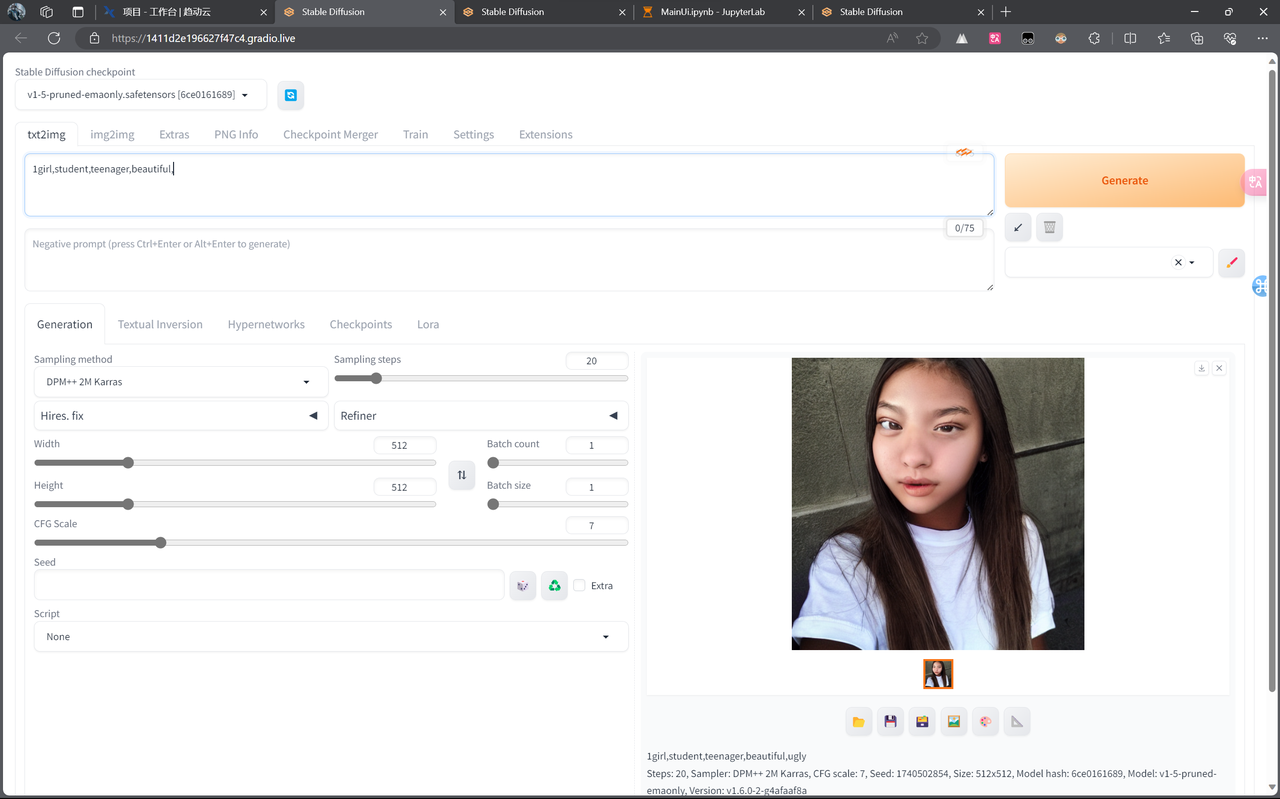

- 理论上,你只要填入提示词点击生成,就可以画出你想要的图片,然而现实很骨感,画出来的图总是不尽人意,比如说下面这张(胆小慎入,想看可以翻开):

胆小慎入,想看可以翻开

输入提示词:一个女孩,学生,青少年,美丽(美丽你个头啊,大辟谷效应犯了)

- 为什么我画出来的图和我想象中的模样差距这么大?可能是你的提示词使用不到位!提示词是 Stable Diffusdion 的灵魂,他是你与模型沟通最重要的渠道之一,只有写出让机器完全理解你的提示词,才能绘画出你心中所想的图片。下面我们来介绍一下 Prompt 的使用技巧。

Step2:Prompt 技巧

提示词分为正面提示词和负面提示词,这两种提示词同等重要,两者都不可忽略!

正面提示词

- 人物主体特征:服饰穿搭 / 发型发色 / 五官特点 / 面部表情 / 肢体动作

- 场景特征:显著影响场景 / 大场景 / 小细节 / 白天黑夜 /

- 视角:镜头距离 / 人物比例 / 观察视角

- 画质:best quelity/ultra-detailed(高分辨率 / 高质量等提示词)

- 画风:二次元(anime)/ 真实(realistic)

负面提示词

- 负面提示词包括的部分很多,不仅可以让你去除不想要的画面细节,还可以避免 AI 画出一些不是人的东西(欢乐谷效应犯了)例如 AI 绘画常出现的多人 / 多手 / 多脚 / 肢体漂浮 / 人物畸形等等等等,我这里先给大家一套我自己常用的超长吟唱魔法,可以应对大部分画面出错的问题,我想应该可以对你有些帮助。

常用负面提示词

Multiple people,long neck,acnes,missing limb,deformed,mutated,malformed limbs,mutation,bad body,long body,(fat:1.2),skin spots,skin blemishes,disfigured,ugly,fused fingers,too many fingers,extra legs,bad feet,cross-eyed,mutated hands,poorly drawn hands,malformed hands,floating limbs,mutated hands and fingers,disconnected limbs,poorly drawn face,bad hands,missing fingers,extra arms,extra limb,blurry,low quality,monochrome,username,out of focus,grayscale,worstquality,signature,watermark,bad anatomy,sketches,lowres,bad proportions,cropped,

如果你有兴趣的话,可以把这段咒语放进翻译软件里,看看这段咒语到底在说啥

- 接下来让我们用详细的 prompt 再来画一张图片试试看,效果就会好很多啦(至少像个人了)

4. 更多样的风格:更换模型

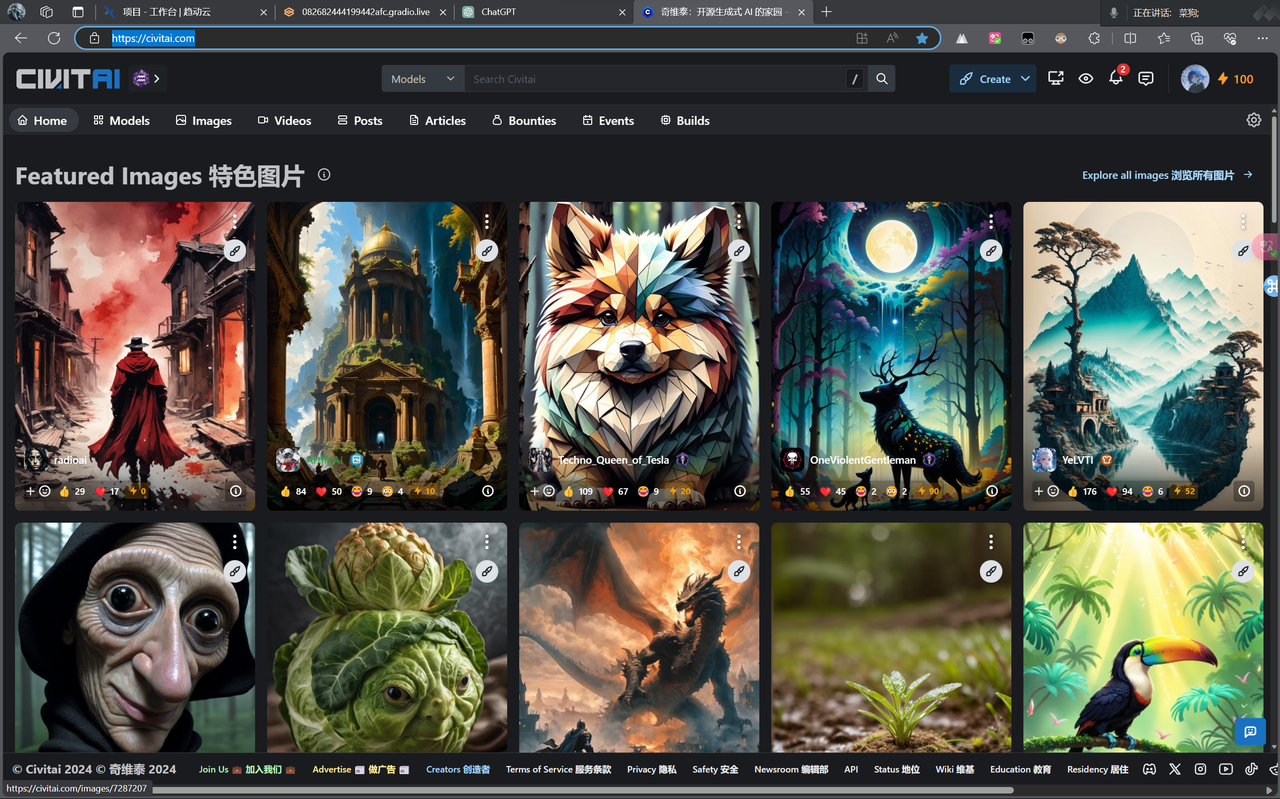

Step1:寻找模型

为什么我的图片画出来的效果那么烂?可能是底模(基底模型)不太好!我们默认使用的是官方的预训练模型 v1-5-pruned-emaonly,它生成的图片比较基础,很多地方也不太细致。

- 我们可以去一些网站找找我们喜欢的模型,例如 Civita 或者 Huggingface

这里有数不清的模型供你选择!你可以选择一个你喜欢的模型,然后进入下载。

图为 Stable Diffusion 使用 counterfeit V2.5 模板生成图片

🤔模型太多了,有什么推荐的模型让我使用吗?

模型根据使用场景,一般可以分为动画类(anime)和现实类

- 动画类的模型 anythingV5 和 counterfeit V2.5 是比较常用的 anime 模型,一般用于生成可爱的二次元图片,本人也经常用 counterfeit 在出图,如果你对二次元很感兴趣,这两个可以拿来入手

- 现实类的模型门类比较复杂,Deliberate 模型用于生成现实的人像,Realistic Vision V6.0 B1 专注于真实的场景和人物,Product Design 适合生成 3D 感十足的简单物体,根据需要在网络上寻找你需要的模型!

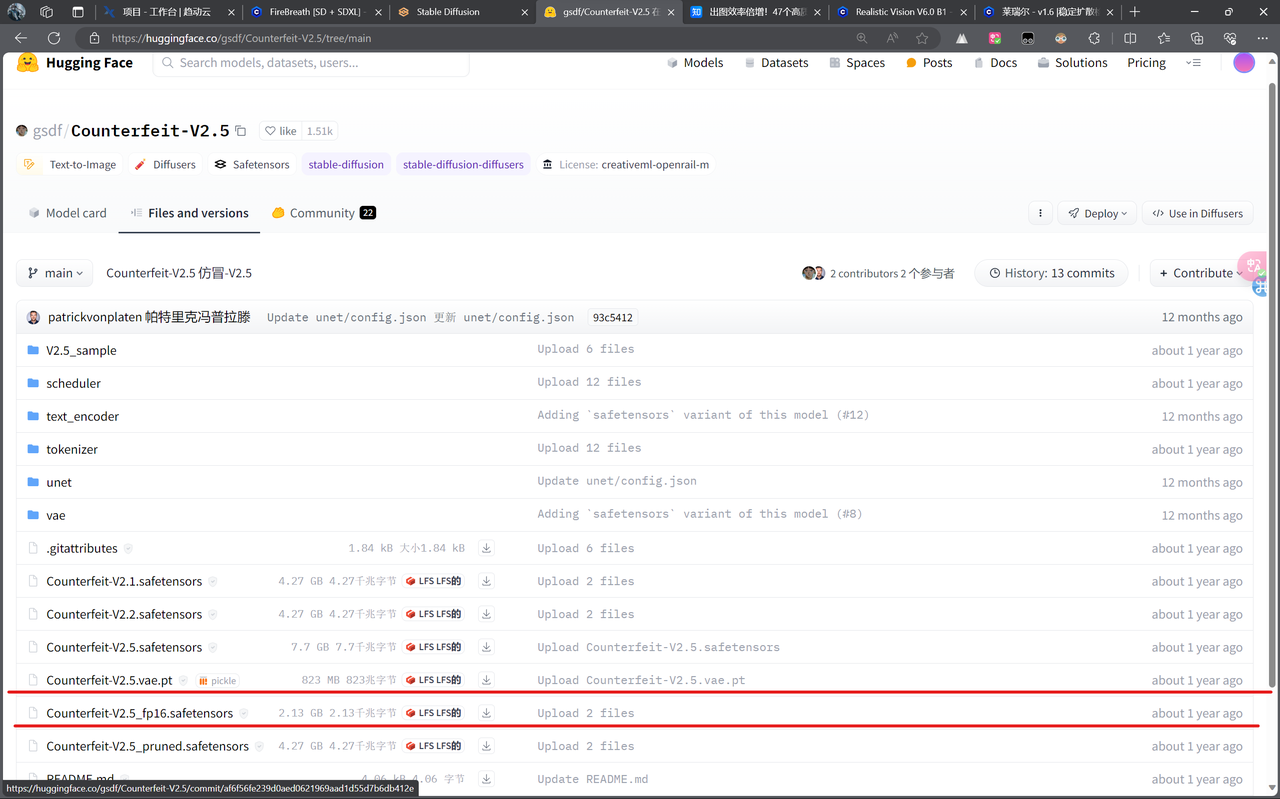

Step2:下载模型

在 Civita 中,下载模型非常方便,因为你甚至不需要注册账号(但可能需要一些其他东西)!(魔搭社区也有快速体验版)

进入你想下载的模型界面,点击下载键,这个后缀 safetensor 的文件就是模型啦!

这样就下载好了!如果你在 HuggingFace 里下载模型,就只要下载后缀 safetensor 的文件即可,如果有 vae.pt 也一并下载

🤔VAE 是什么?VAE 在哪里使用?

- VAE,全名 Variational autoenconder,中文叫变分自编码器。作用差不多可以理解为滤镜。 在生成 AI 绘画时,会对输出的颜色和线条产生影响。简单来说,vae 可以让你的图片生成线条更加清晰,画面更加明亮,模型和它搭配使用效果更佳

Setting - User Interface - Quicksettings list中加入sd_vae, 点击 Apply,再点击 Reload,就会发现 model 的旁边新出现了 vae 的选择框了。

Step3:安装模型

1. 普通上传

- 找到趋动云服务器的 JupyterLab,在左侧找到文件夹 gemini/code/stable-diffusion-webui/models/Stable-Diffusion,你会发现里面还有一个 v1-5-pruned-emaonly.safetensors 这就是官方模型,我们将刚下载的模型拖入文件夹目录中

2. SSH 上传

这个方法的目的是加快模型的上传速度,在 Web 中文件的上传速度还是有所限制,我们可以打开趋动云的 SSH 功能,通过 SSH 我们的文件可以上传的更快

在这里,你可以选择用你自己的电脑终端或者使用 VScode/terminus 之类的软件来连接服务器

Step4:使用模型

- 当你安装好模型之后,回到 webUI 界面,再点击左上角的模型选项,你会发现你的模型已经加载进去了。现在,你可以自由的使用这个模型来进行出图了!

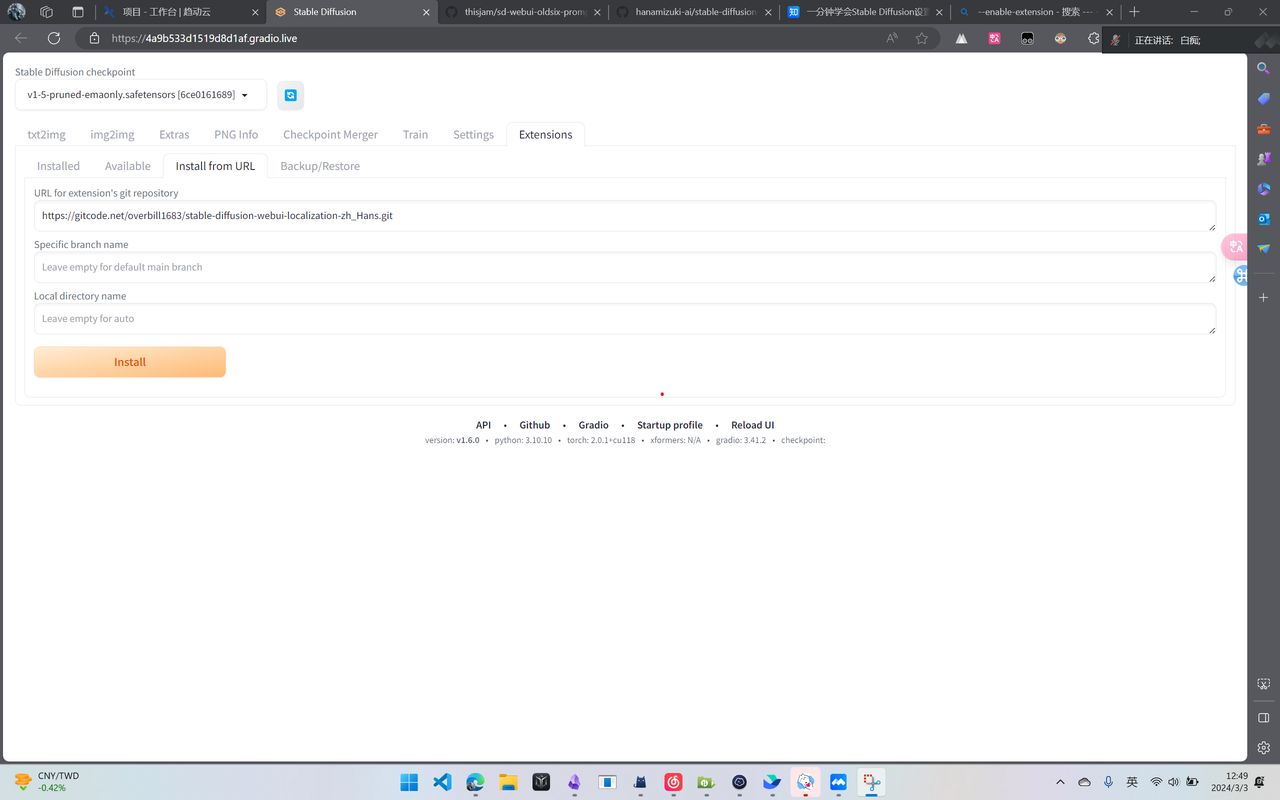

5. 更方便的使用:插件安装

Step1:安装教程

Stable-Diffusion 拥有大量便捷的插件,可以实现由小到大的各个功能!

如果你要安装插件,首先你要退出正在运行的 Webui,然后用下面的命令再启动一次

python launch.py --share --listen --enable-insecure-extension-access

这个时候就可以在 webui 中下载插件了!

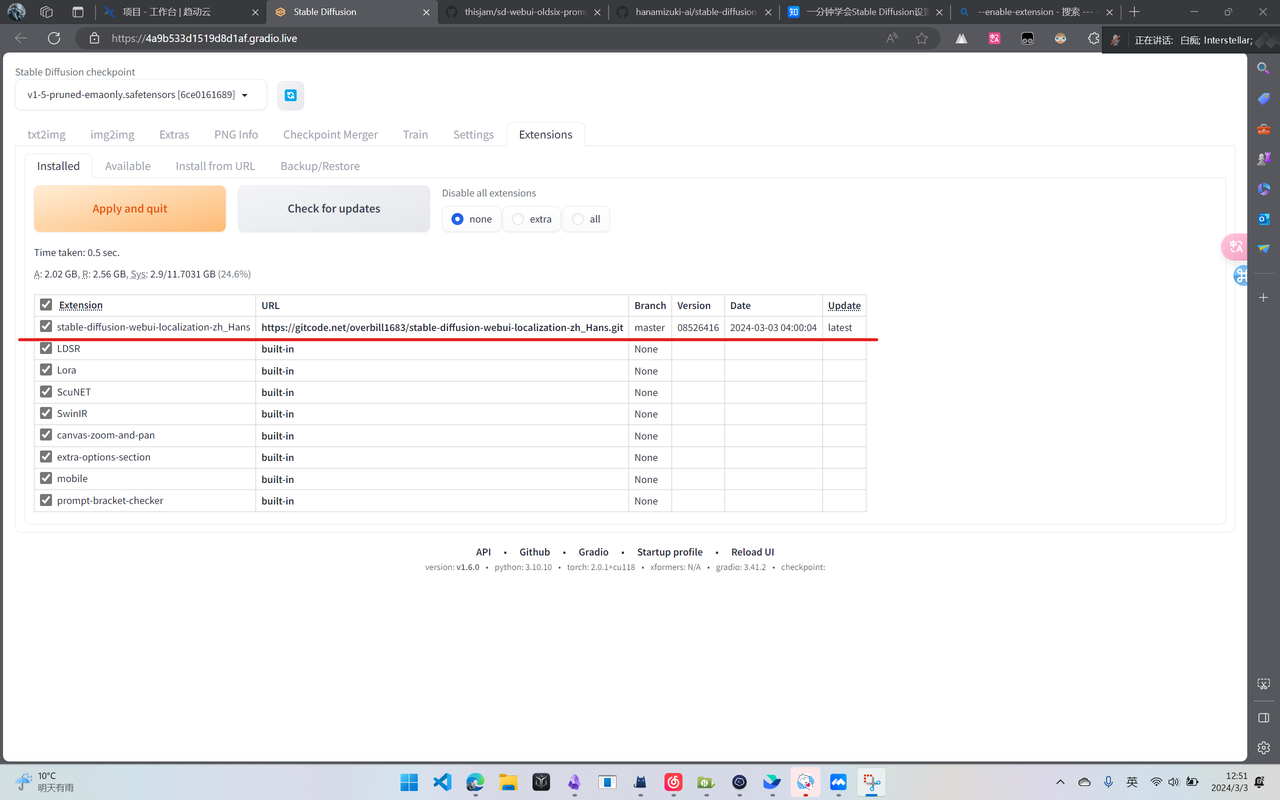

点击 Extension-Install from URL,输入插件的 Git 网址,点击 Install,就可以安装了!我们先来装一个中文插件,在

URL for extension's git repository中输入:https://gitcode.net/overbill1683/stable-diffusion-webui-localization-zh_Hans.git

我们回到 Installed,发现多了一个插件,这就是我们新安装的插件!

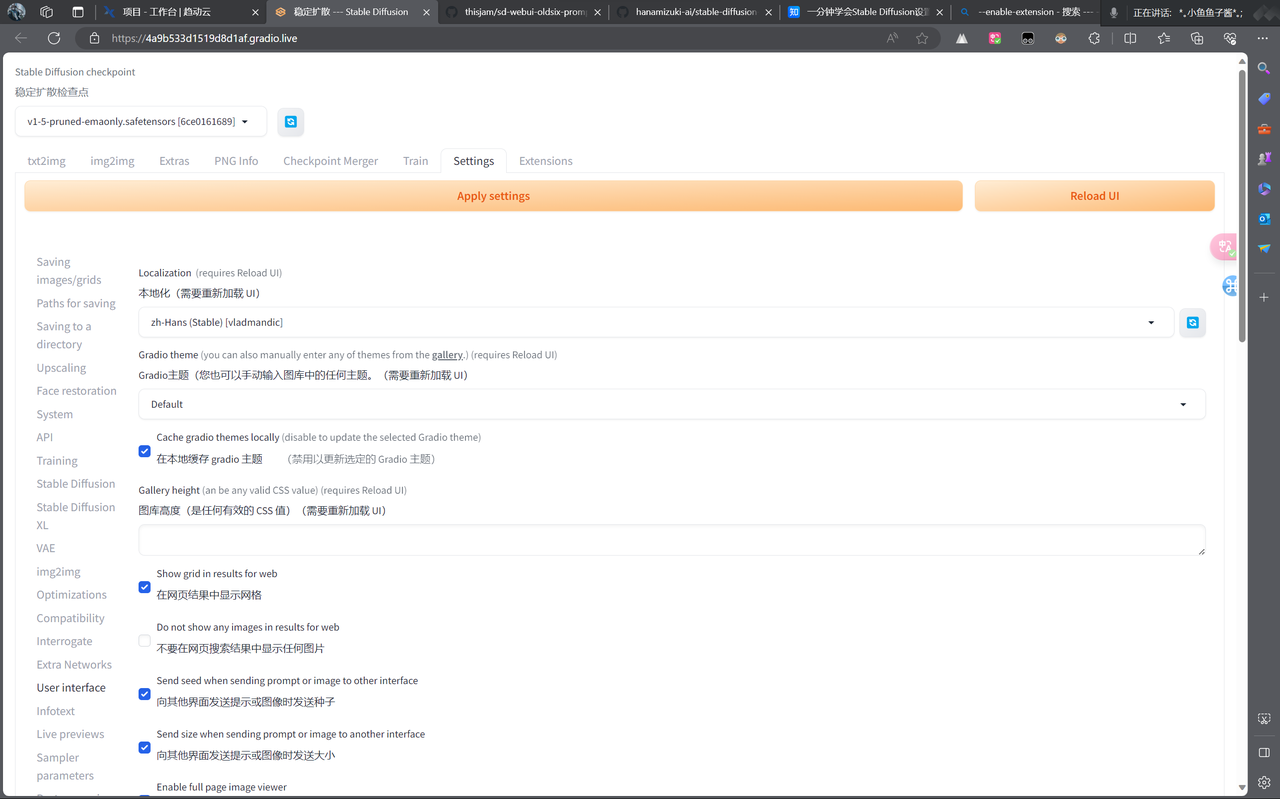

现在我们来到 Setting-User Interface-Localization,来设置我们新安装的中文插件,点击 Apply setting,再点击 Reload UI,你的界面就变成中文的了!

Step2:插件推荐

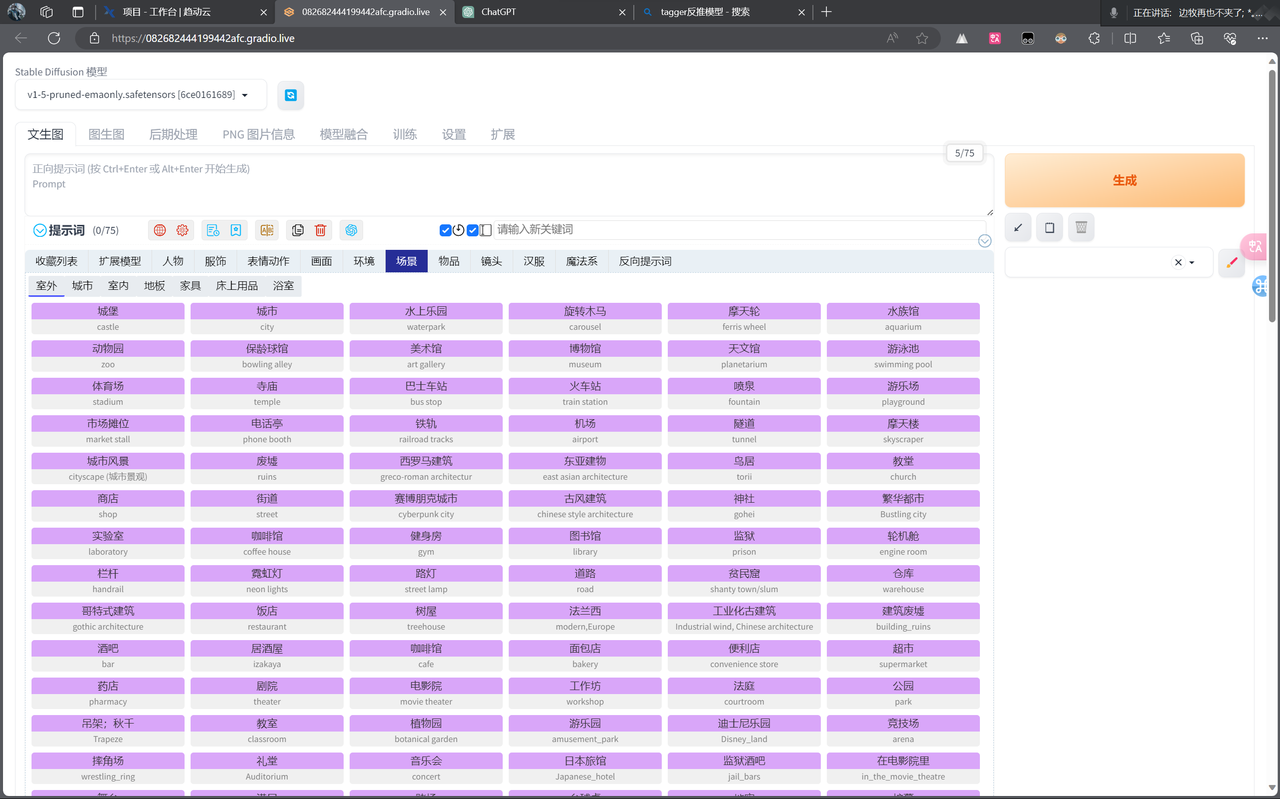

- oldsix:超好用的提示词插件!作为一个 sd 新手,对于提示词的使用会很没有方向,oldsix 作为一个全中文插件,提供了大量常见提示词,也就是说,你只要在 webui 里点点点,挑选你心仪的提示词,就可以创造出你想要的画!

- Prompt-all-in one:提示词补全插件,输入前几个字母就能补全你想输入的提示词

URL:https://github.com/Physton/sd-webui-prompt-all-in-one.git

- tagger:标签反推插件,炼模型会用到

- WD1.4:打标插件,炼模型会用到

常见问题

如果你在安装插件过程中遇到 128 报错,那么大概率是网络出现了一些问题!你可以在终端里(stable-diffusion-webui 文件夹下),输入下面的代码的方法来安装插件

git clone "https://gitclone.com//github.com/Physton/sd-webui-prompt-all-in-one.git" extensions/sd-webui-prompt-all-in-one

双引号是你要下载插件的 URL,后面是下载到本地的路径(extensions / 你想取插件文件夹名字,一般取 URL 最后一节)

git 到本地以后重启 webui,插件就安装上了! :::